OllamaとOpenCodeでバイブコーディングWindows環境 を無料で簡単に構築

OpenCode

OpenCode | オープンソースのAIコーディングエージェント

choco install opencode

Ollama

https://github.com/ollama/ollama/releases

ollama-windows-amd64.zip 解凍しフォルダーの中に入れます

モデルの場所を変えるバッチファイル

call D:\WinPython\scripts\env_for_icons.bat %*

set OLLAMA_GPU_LAYER=cuda

set OLLAMA_MODELS=E:\ollama\models

echo Starting Ollama...

start "" /B E:\ollama\ollama.exe

echo Waiting 10 seconds before stopping...

timeout /t 10 >nul

echo Stopping Ollama...

::taskkill /IM ollama.exe /F >nul

echo Ollama stopped.

::start E:\ollama\ollama.exe run qwen3:8b

::start E:\ollama\ollama.exe run qwen2.5-coder

pause

::opencode web --port 4096

cmd/k

::localhost:11434OpenCode用にモデルをダウンロード

ollama launch opencode --model qwen2.5-coder

ollama launch opencode --model deepseek-r1

起動しない場合

ollama launch opencode --configtoolsかついているモデルを選んでください

実行すると

C:\Users\User\.config\opencode\opencode.json

C:\Users\User\.local\state\opencode\model.json

に設定ファイルを作ってくれます

{

"provider": {

"ollama": {

"models": {

"deepseek-r1": {

"_launch": true,

"name": "deepseek-r1"

},

"qwen2.5-coder": {

"_launch": true,

"name": "qwen2.5-coder"

}

},

"name": "Ollama",

"npm": "@ai-sdk/openai-compatible",

"options": {

"baseURL": "http://localhost:11434/v1"

}

}

}

}使い方

次のモデルが無料で使用できるようになってます

MiniMax M2.5 Free

Nemotron 3 Super Free

Big Pickle起動

cd /path/to/project

opencode

指示

Pythonを使って「Hello World」を表示

モデルを選んで起動する

opencode --model ollama/codellama

続きから実行 セッション番号を教えます

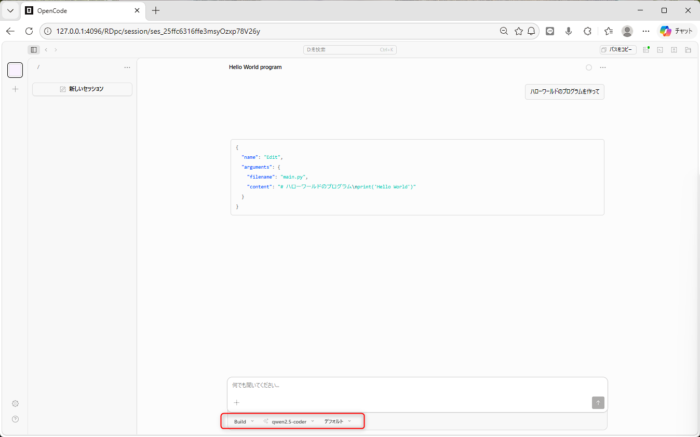

opencode -s ses_25ffc6316ffe3msyOzxp78V26yplan は調査向け build は実装向け

ブラウザで OpenCode を使用する

opencode web

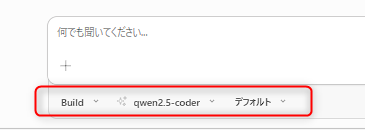

plan build モデルの選択

ディスカッション

コメント一覧

まだ、コメントがありません